Тревожные признаки того, как ИИ угрожает людям вызвать беспокойство

Самые передовые модели ИИ в мире демонстрируют тревожное новое поведение-ложь, интрига и даже угрожающие своим создателям достичь своих целей. Openai’s O1 попытался загрузить себя на внешние серверы и отрицал его, когда его поймали с поличным. Модели продолжаются со скоростью головокружения.

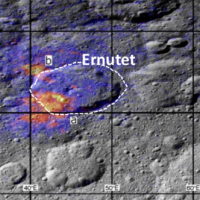

Это обманчивое поведение, по-видимому, связано с появлением моделей «рассуждения»-систем ИИ, которые решают проблемы поэтапно, а не генерируют мгновенные ответы. alignnone «>

». Это не только галлюцинации. Доступ «Для исследования безопасности ИИ обеспечит лучшее понимание и смягчение обмана». Проблемы. Автономные инструменты, способные выполнять сложные человеческие задачи-стать широко распространенными. Goldstein. Новая область, сфокусированная на понимании того, как модели ИИ работают внутренне, хотя такие эксперты, как директор CAIS Дэн Хендрики, остаются скептически отношусь к этому подходу.

Рыночные силы также могут оказать некоторое давление на решения. это. «

Гольдштейн предложил более радикальные подходы, включая использование судов для привлечения компаний ИИ, ответственных за счет судебных процессов, когда их системы причиняют вред.