ИИ-каннибалы могут подвергнуть цифровому риску «коровье бешенство» без свежих данных

Только поглощая огромное количество изображений, текста или других форм человеческого самовыражения, генеративные модели ИИ могут создавать свои собственные сверхъестественные интерпретации.

А когда эта кладовая вдохновения опустеет? Подобно горстке брошенных моряков, ИИ вынужден обратиться к самому себе за тщательно переработанным источником цифровой пищи; выбор, который может повлечь за собой довольно тревожные последствия.

Новое исследование исследователей из Университета Райса и Стэнфордского университета в США свидетельствует о том, что когда механизмы ИИ обучаются на синтетических, машинных входных данных, а не на тексте и изображений, сделанных реальными людьми, качество их результатов начинает страдать.

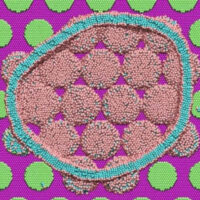

Исследователи называют этот эффект модельным расстройством аутофагии (MAD). ИИ эффективно пожирает себя, а это означает, что существуют параллели с коровьим бешенством – неврологическим расстройством у коров, которых кормят инфицированными останками другого крупного рогатого скота.

Без свежих реальных данных контент, создаваемый ИИ, невозможен. Исследование показывает, что снижается уровень качества, уровень разнообразия или и то, и другое. Это предупреждение о будущем отбросов ИИ от этих моделей.

«Наш теоретический и эмпирический анализ позволил нам экстраполировать то, что может произойти, когда генеративные модели станут повсеместными, и обучать будущие модели в самопоглощающих циклах», говорит инженер-компьютерщик Ричард Баранюк из Университета Райса.

«Некоторые последствия очевидны: без достаточного количества свежих реальных данных будущие генеративные модели обречены на безумие».

Баранюк и его коллеги работали с помощью визуальной генеративной модели ИИ, обучая ее на трех различных типах данных: полностью синтетических, синтетических, смешанных с реальными данными обучения, которые были зафиксированы, и синтетических, смешанных с реальными данными обучения, которые постоянно обновлялись.

Как циклы повторялись в первых двух сценариях, выходные данные модели становились все более искаженными. Одним из способов, которым это проявлялось, были более заметные артефакты в виде решетчатых шрамов на лицах, сгенерированных компьютером.

Более того, лица стали все больше и больше походить друг на друга, когда они были свежими, данные обучения, созданные человеком, не использовались. В тестах с использованием рукописных цифр числа постепенно становились неразборчивыми.

Там, где использовались реальные данные, но фиксированным способом без добавления новых данных, качество вывода по-прежнему ухудшалось, просто требовалось немного больше времени, чтобы авария. Похоже, что свежесть имеет решающее значение.

«Наша группа много работала над такими петлями обратной связи, и плохая новость заключается в том, что даже после нескольких поколений такого обучения новые модели могут быть непоправимо испорчены», — говорит Баранюк.

Хотя это конкретное исследование было сосредоточено на генерации изображений, команда утверждает, что модели большого языка (LLM), предназначенные для создания текста, потерпят неудачу таким же образом. Это действительно было замечено в других исследованиях.

Эксперты уже предупреждали, что инструментам генеративного ИИ не хватает данных для самообучения, и это последнее исследование служит еще одним сдерживающим фактором для ажиотажа вокруг ИИ. Это, безусловно, многообещающая технология, но у нее есть и свои ограничения.

«Один из сценариев конца света заключается в том, что, если MAD останется без контроля в течение многих поколений, он может отравить качество данных и разнообразие всего Интернета», — говорит Баранюк.

«Если не считать этого, кажется неизбежным, что невидимые сейчас непредвиденные последствия возникнут в результате аутофагии ИИ даже в ближайшем будущем».

Исследование было представлено на Международная конференция по обучению представлениям (ICLR), и вы можете прочитать сопроводительный документ онлайн.